多源动作数据采集与整合

项目定位

这部分工作的目标不是只做单一数据集下载,而是围绕数字人的动作表达,把来源、粒度和应用场景都不同的数据源持续整理到一个可用的数据池里,支撑后续的动作重建、动作生成和角色驱动任务。

MRI Hand Data Music2Dance CyanPuppets Speech2Gesture OPPO Internship Dataset Integration

数据源拆解

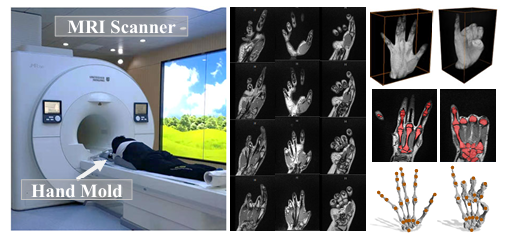

MRI 手部数据主要补足常规全身动作数据对细粒度手部形态和关节表达覆盖不足的问题,更适合做高精度手部动作或医疗相关交互研究。

- MRI 手部数据采集:重点关注手部动作和手型重建所需的高精度数据,价值在于能补充常规全身数据难以覆盖的手指细节和关节形态。

- Music2Dance:持续汇总 AIST++、DanceWithMelody、PhantomDanceDataset、GDance 等公开舞蹈数据集,重点比较规模、风格和动作表示形式,并额外验证普通视频采集方案的边界。

- CyanPuppets:关注多机位视频采集方案在角色动作覆盖、视角切换和后续数据整理上的可行性,更偏向采集方案验证,而不是骨骼重定向或 FBX 处理。

- Speech2Gesture:这部分对应我在 OPPO 实习参与的中文数据集采集工作,重点不是算法训练,而是围绕多视角视频做审核、筛选和可用性整理,为后续语音驱动手势任务准备可训练数据。

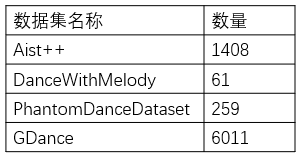

Music2Dance 数据集汇总与示例视频

这里汇总了公开 Music2Dance 数据源,用于快速判断不同舞蹈数据源的规模,并对比它们各自动作表示形式是否适合纳入后续数据池。

这段跳舞视频展示的是 Music2Dance 方向的动作预览,用来说明这部分工作关注的是音乐驱动舞蹈动作数据及其表现形式。也可单独打开查看原视频。

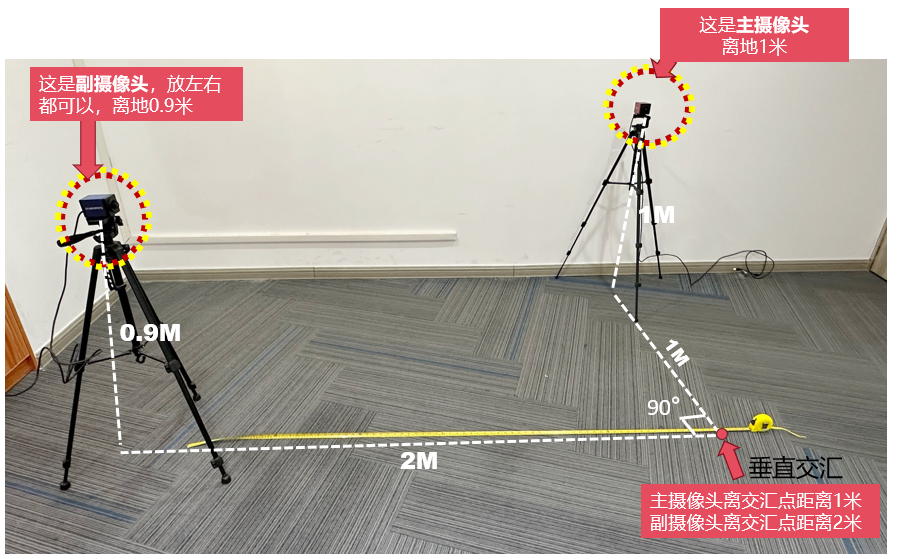

CyanPuppets 多机位视频采集方案

左图对应的是多机位视频采集方案本身,重点是机位间距、主辅机位关系和拍摄覆盖范围。

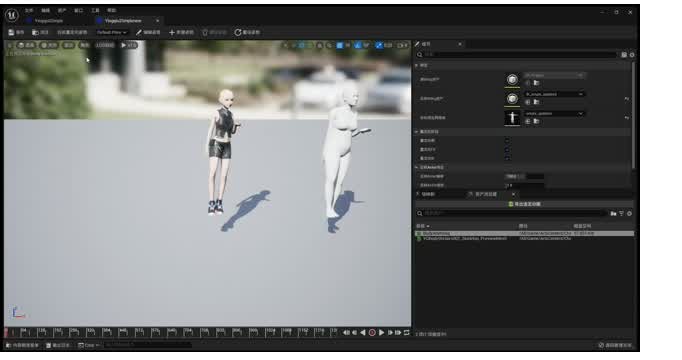

右图对应的是采集方案验证时的角色预览界面,用来说明这部分工作最终关注的是角色动作记录与多视角素材组织。

Speech2Gesture 数据集采集(OPPO 实习)

这部分对应的是中文多视角数据集采集与审核工作,重点是围绕 6 个视角下的视频做数据筛选和可用性整理,而不是展示单人动作结果预览。

- 工作背景:Speech2Gesture 领域中文数据集缺乏,因此在 OPPO 实习阶段补了一部分中文语音驱动手势数据采集与整理工作。

- 工作内容:围绕 6 个视角下的视频做审核、筛选和可用性判断,确保最终筛出的片段能够服务后续手势生成与驱动任务。

- 结果:累计采集 437 条数据,最终合格 352 条,形成了可继续处理和训练的中文数据基础。

- 后处理:后续数据处理沿用

EasyMocap这条链路,把视频进一步整理成可用的动作表示。